生成AIを鵜呑みにしない!正しく使うための3つのポイント

|

|

近年、生成AIはIT技術者の業務を劇的に変化させています。

特にコーディング作業では、数時間を要していた作業がわずか数分に短縮されるケースも報告されています。

しかし、生成AIを信じすぎるがあまり、失敗を招いてしまうことも……。

そこで、本コラムでは、生成AIが引き起こす具体的な失敗事例を深掘りし、生成AIとうまく付き合う方法をご紹介します。

|

|---|

<執筆者> 木本 佳希 Kimoto Yoshiki

ビジネスインフラ技術本部 クラウド技術統括部

2024年中途入社。前職ではITコンサルタントとして従事。

フロントエンドからインフラまで、フルスタックな技術経験を積む。

現在はフィールドエンジニアとして、AWS関連の支援を行いつつ、AWS認定講師として研修講師を務めている。

趣味は頭を使うこと。転じてパズルゲームや将棋、脳トレを好む。

ただ記憶することは苦手で、MENSA会員だったが、資格更新を忘れて失効した過去を持つ。

生成AIの失敗事例

生成AIを現場で活用する中で、効率化を目指したはずが、かえって学習コストや作業コストが増大してしまうという失敗事例が数多く見受けられます。

失敗事例1:トータルの開発工数が増大する

生成AIの活用により、コーディング速度を劇的に改善することができるようになりました。

例えば、従来の開発では数時間かかっていたようなコーディングでも、生成AIを使えば数分で終えることができます。

しかし、コードの生成までは非常に高速に行えても、その後のデバッグでこれまで以上に時間がかかり、結果的にトータルの開発工数が大幅に増加してしまうケースがあります。

これは、生成AIから出力されるコードの量が多い ことが原因です。

人間は、生成AIが出力した大量の生成物を確認する作業(コードレビューなど)に非常に多くの時間を要します。

そして、その量があまりにも多すぎると、確認を諦めてすぐに使おうとしてしまうことがあります。

結果としてエラーだらけのコードをとりあえず動かそうとし、それでも動かなくてデバッグするために多くの工数をかけることとなり、効率化できないどころか、全体の工数が増大してしまうのです。

失敗事例2:AIを信じて誤った知識を習得する

AIの出力で発生する ハルシネーション(事実と異なる情報や誤った内容を、あたかも正しいかのように回答してしまう現象) によって、誤った知識を習得するリスクがあります。

私が若手向けの研修をしていた時、参加者に「テキストに書かれている内容が間違っているのではないか」と質問されたことがあります。

その根拠は「生成AIに聞いたらテキストと違う回答をしたから、テキストが間違っていると思った」というものでした。

しかし実際はテキストが正しく、生成AIが間違っているという状況でした。

また、私が資格試験の勉強をしていた時には、生成AIにわかりにくい概念をまとめてもらっていました。

模擬試験では自信を持ってその内容に答えたのですが、そもそも生成AIの出力自体が間違っており、不正解だったことがあります。

これらの事例に共通する決定的なポイントは、誰かから指摘されるまで、利用者自身が間違いに気づけない という点です。

生成AIを鵜呑みにする原因とは?

これらの失敗事例を見ると「生成AIの出力を鵜呑みにする利用者が悪い」、「 ファクトチェック(事実に基づいているか、正確かつ妥当かを検証する作業 = 批判的思考の保持) を怠ったのが原因だ」という議論に陥りがちです。

しかし、本当に私たちの責任だけで片付けられる問題なのでしょうか?

原因1:「ファクトチェック」における矛盾が発生する

生成AIを活用する際には「鵜呑みにしないためにファクトチェックを行いましょう」と広く提唱されています。

しかし、ここに大きな矛盾が潜んでいます。

私たちは、基本的に「知らないこと」を知りたいから生成AIを使います。

知らないことを知るために生成AIを使っているのに「その出力が正しいかどうかを確認しなさい」と言われているわけです。

そもそもその情報自体を知らないのですから、出力が正しいかどうかを判断することはできません。

さらに言えば、ファクトチェックをしなければならない「嘘」であるかどうかという点にすら気づくことができないのです。

つまりファクトチェックには「 知らないことについて、正しいかどうか判断する 」という矛盾が発生します。

特に知識習得のために生成AIを活用する場面においては、この矛盾に苦しめられます。

原因2:「認知的オフロード」により思考が停止する

我々が生成AIの出力を鵜呑みにしてしまう根本原因の一つは、生成AIの出力形式にあります。

生成AIは、質問に対して一括で大量の情報を提示します。

一方、人間には「ワーキングメモリ」と呼ばれる処理能力に限界があります。

そのため、大量の情報をまとめて提示されると、その情報に対して「外的認知負荷」を感じ、脳が情報をシャットダウンしようと反応します。

この結果として 認知的オフロード(情報の一部だけで判断を下したり、情報の取捨選択に失敗したりする状態 ) を引き起こしてしまいます。

先に挙げたデバッグ工数が増加した事例も、この認知的オフロードが深く関わっています。

大量のコードを出力された開発者は、あまりにも情報量が多いため、確認作業を面倒だと感じてしまい、確認を諦めてしまいます。

このように、大量の情報提供そのものが、私たちの批判的思考の低下や思考停止を生み出す一因となっているのです。

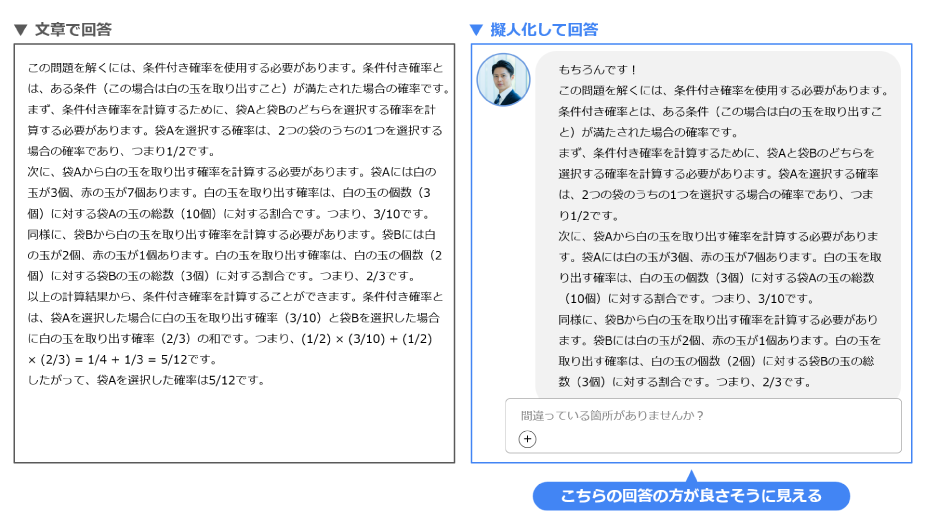

原因3:「擬人化UI」により根拠のない信頼が生まれる

生成AIの「見せ方(UI)」にも原因があります。

チャットボット形式の生成AIサービスは、アイコンが表示されたり、人間的な振る舞いをする「擬人化UI」を採用していることが多いです。

研究結果によると、人間はこの擬人化されたやり取りに対してポジティブな感情を抱きやすいことが分かっています。

そして、このポジティブな感情は、提示された 情報の信頼度を向上させる ことがあります。

重要なのは、この信頼の向上には「根拠がない」という点です。

ユーザーは「なんとなくこっちの方が良さそうだ」、「チャット形式だから信頼できる」という根拠のない信頼感を抱き、無闇に批判的思考を低下させられてしまうのです。

擬人化UIにより「なんとなく良さそうだ」と根拠のない信頼感を抱くことがあります。

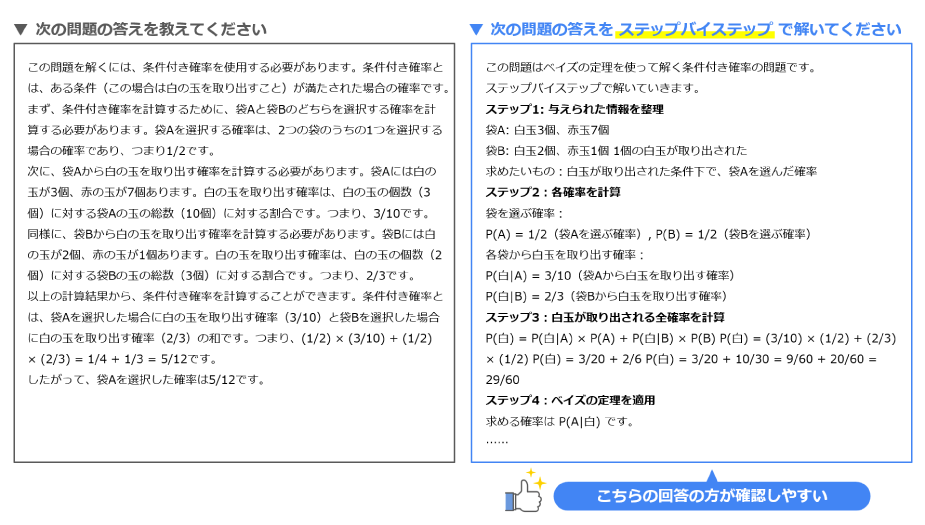

<質問>

次の問題の答えを教えてください。

【問題】

A、B2つの袋があり、それぞれの袋には以下の個数の玉が入っている。

A:白が3個、赤が7個

B:白が2個、赤が1個

ある人が2つの袋から片方を無作為に選択し、その袋から1個の玉を取り出したら白の玉だったとする。

この時、Aの袋を選択した確率は?

<回答例>

※ハルシネーションが発生しています。

|

|

生成AIを正しく使うための3つのポイント

「生成AIで失敗しないために、生成AIを使わない」という選択は、世界から取り残されてしまうことと同意です。

私たちが取るべき本質的な対策は、生成AIを正しく知り、うまく付き合うことです。

ここでは、生成AIとうまく付き合うためのテクニックを3つご紹介します。

1:認知オフロードを減らすために「出力を小型化」する

一度に大量の出力があると、人間はうまく処理できません。

人間が確認しやすいレベルに、少しずつ出力することが重要です。

「ステップバイステップで解いてください」

この一言を付け加えるだけで、生成AIはその応答文を構造化し、プロセスごとに分割して出力してくれます。

「まず、Aを分析してください」「次に、その結果からBを抽出してください」

いきなり最終成果物を生成させるのではなく、タスクを細かく区切って指示することも有効です。

この指示の結果、一度に出力される量が減り、人間が情報を認識しやすくなります。

プロセスごとに分割して回答されるので、情報を確認しやすくなります。

<回答例>

※ハルシネーションが発生しています。

|

|

2:ファクトチェックではなく「妥当性を判断」する

従来のファクトチェックが「知らないことのチェック」という矛盾を抱える以上、私たちはチェックする対象を変える必要があります。

「出力が正しいかどうか」の判断ではなく「その出力がもっともらしいか」という妥当性を判断しましょう。

チェックのレベルを下げることで、内容の「怪しさ」に気づきやすくなります。

「この情報の根拠は?」「出典や参考元も一緒に教えてください」

このような指示をプロンプトに含め、情報源を確認すると良いでしょう。

この際、生成AIの回答に加え、信頼できるWebサイトや専門家の論文など、複数の情報源と照らし合わせて妥当性を確認することが理想です。

3:妥当性を判断できる「基礎知識を習得」する

しかし、妥当性を判断するためにも、前提となる知識が必要となります。

例えば、生成AIで出力した内容に詳しいベテランと、全く知らない新人で比較すると、以下のような違いが出てきます。

・ベテラン : 経験や知識と照らし合わせ、出力が「正しそうか」「違いそうか」を判断し、情報の取捨選択ができる

・新 人 : 判断するための経験や知識がないため、生成AIの出力をそのまま鵜呑みにしてしまい、誤った知識習得が生じやすい

では、ベテランのように妥当性が判断できるようになるため、効率的に学ぶにはどうしたら良いでしょうか。

サービスを提供しているメーカーや代理店から情報を仕入れる

IT知識に関しては、これが最も手っ取り早く確実な方法です。

多くのサービス提供者は、サービスの基本的なルールや考え方から学べるよう、体系的なカリキュラムを提供していると思いますので、それをうまく活用しましょう。

生成AIを組織の成長に繋げるために

生成AIは強力なツールですが、正しく付き合うことができない場合、誤った知識が組織全体に入り込んだり、社員の思考停止を招いたりする可能性があります。

そうならないためにも、本コラムでご紹介した「生成AIとうまく付き合うためのテクニック」である

- 「出力を小型化」する指示を出す

- 「妥当性を判断」するために情報源を確認する

- 妥当性を判断できる「基礎知識を習得」するために研修などを活用する

という3点を意識してみてください。

ちなみに、弊社アシストでは「基礎知識を習得する」ための様々な研修や支援サービスをご用意しています。

例えば、DX人財の育成に関しては「ToBe構想ワークショップ」「生成AI棲み分け支援」「AIテーマ推進支援」「DX/AI人財教育コーディネート」などの伴走型支援サービスを、アマゾン ウェブ サービス(以下、AWS)に関してはAWSの公式トレーニングである「AWS認定研修(AWS認定トレーニング)」を提供しています。

実際に研修を受講したお客様からは「効率的に必要な知識や原理・原則を学ぶことができた」、「体系的な知識を持つことで生成AIの出力の妥当性を判断できることを身にしみて感じている」、「生成AIの回答が尤もらしいかどうか気にかけられるようになった」という嬉しい声をいただいています。

もしご興味があれば、ぜひお気軽にご相談ください。

本コラムが、みなさまの生成AIの活用の一助になれば幸いです。

|

|

オリジナルテキストを用いた研修サービスや伴走型の支援サービスを通じて、お客様の成長をサポートします。 |

本ページの内容やアシスト西日本について何かございましたら、お気軽にお問い合わせください。