生成AIのセキュリティリスクとは?企業が直面する課題と対策

2024.07.11

|

|---|

<執筆者> 大野 秀男 Ohno Hideo

ビジネスインフラ技術本部 システム基盤技術統括部

技術6部 課長

1999年アシストに入社。BI製品の教育サービスやサポートを担当した後、様々な製品の担当技術となる。

近年はセキュリティ製品のプロダクトマネージャーとして活動。

とにかく動くことが大好きで、プライベートではテニス、ランニング、スキーなどを楽しんでいる。

はじめに

ChatGPT。

初めてその名前を聞いた時は「ふーん、そんなのあるんだ」と思っただけでした。

しかし、ChatGPTを実際に利用してみると、その便利さや精度に驚愕してしまいました。

特に仕事をしていく上で、分からないことを調べる時や頭を整理したい時に、生成AIを活用する機会が増えているように感じます。

こういった便利なものは積極的に使っていけば良いと思いますが、その反面、セキュリティリスクも考えていかなければなりません。

そこで本コラムでは、生成AIを活用していく上でのセキュリティリスクやセキュリティ対策について解説していきます。

生成AIによるセキュリティリスク

以下は、日本セキュリティ監査協会が2024年1月に公開したセキュリティトレンドです。

情報セキュリティのトレンド

| 順位(2024年) | 順位(2023年) | 項目 |

|---|---|---|

| 1位 | ランク外 | 生成AIの悪用と誤用により増加するセキュリティ事故 |

| 2位 | 3位 | 他人事ではありません。日常化するランサムウェア被害 |

| 3位 | 9位 | 国家支援型組織によるサイバー攻撃の深刻化 |

| 4位 | 2位 | 重要インフラを支える供給網(中小企業)がサイバー攻撃ターゲットに |

| 5位 | ランク外 | 重要性が高まる事前評価、生成AIのリスク |

参考:情報セキュリティ監査人が選ぶ情報セキュリティ十大トレンド(2024年予測)

https://www.jasa.jp/seminar/sec_trend2024/

(2024/7/11時点の情報)

前年ではランク外であった生成AI関連のセキュリティリスクが、1位と5位にランクインしています。

このデータからも分かるように、企業で生成AIを活用するためには、

セキュリティ対策も合わせて検討することが急務となっています。

では、生成AIにおける具体的なセキュリティリスクとはどのようなものがあるでしょうか?

アシストでは主に以下の4点があると考えます。

生成AI活用のセキュリティリスク

- 不正確な情報の生成 誤った情報や偏見を含むコンテンツを作成 ⇒ 誤情報の拡散、ブランドの信頼が失墜

- 著作権侵害のリスク 既存の著作物を模倣する形でコンテンツを作成 ⇒ 著作権侵害、法的な問題に発展

- ビジネスデータの漏洩 生成AIを利用する過程で機密情報、個人情報を入力 ⇒ 情報漏洩

- セキュリティ攻撃の助長 攻撃者が生成AIを悪用 ⇒ フィッシングメールやマルウェアを開発

これらのセキュリティリスクの中でも「ビジネスデータの漏洩」については、直接的なセキュリティ事故に繋がります。

既にいくつかの企業でも、機密情報をChatGPTに入力したことで情報漏洩に繋がったケースがあります。

とある海外企業において

・バグがあるソースコードをコピーして修正を依頼

・会議音声をチャットボットに投げて、議事録を作成

などの作業で、機密情報をChatGPTに流出させたというニュースが報じられたそうです。

以下の記事でも「従業員がChatGPTに貼り付けるデータの11%は機密情報」だと伝えているように、

どの企業でも起こりえることで、他人事ではありません。

企業としては、このような問題が発生する前に準備をしておく必要があります。

参考:11% of data employees paste into ChatGPT is confidential

https://www.cyberhaven.com/blog/4-2-of-workers-have-pasted-company-data-into-chatgpt

(2024/7/11時点の情報)

企業における生成AI導入ステップ

生成AIを企業で活用していくためには、以下のようなステップを踏むと良いでしょう。

企業における生成AI導入ステップ

- リスク評価

生成AIの利用にともなうリスクを評価

個人情報の取り扱いや、コンプライアンスも考慮する - ガイドライン策定

情報処理推進機構が一覧にまとめた「AI活用のためのガイドライン類」などを参考に、企業独自のガイドラインを策定

<最低限含めることを推奨される内容>

・ガイドラインの目的や前提事項

・対象とする生成AI

・データを入力する際に注意すべき事項

・生成物を利用する際に注意すべき事項 - ユーザー教育

具体的な利用ケースや注意点に焦点をあてたトレーニングプログラムを設計

受講を必須とする - モニタリングと遵守

ガイドライン違反の監視体制を整備

リスクを早期に検出する

これらのステップを継続的に見直し、更新することが重要です。

しかし、いくら上記ステップを踏んだとしても

・単純なミス

・ユーザー教育が一度きりで、リスクに対する意識が低くなる

・ガイドラインに従わない

などのヒューマンエラーを防ぐことはできません。

そこで有効となるのが、

システムを導入して強制的にルールを適用させるセキュリティ対策

です。

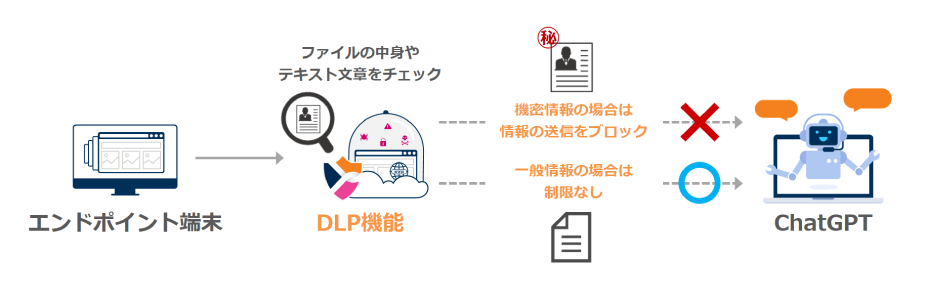

生成AI活用におすすめしたいセキュリティ対策「DLP」とは

これまでのセキュリティ対策は、主に「人(ID)」や「デバイス」を中心に考えられていました。

今後もその対策は必要ですが、別の要素として「データ」を中心とした考えが出てきました。

それが「DLP(Data Loss Prevention)」です。

DLPとは、

保護すべき機密情報を自動的に判別し、該当データが検出された際にアラート通知やブロックを行う仕組み

です。

クレジットカード番号やパスポート情報など、機密情報と思われるデータが移動する際に検出し、

その作業を止めてしまうことで、情報漏洩を防ぐことができます。

DLPにはいくつか種類がありますが、

生成AIのセキュリティ対策としては「ネットワークDLP」が有効

だと考えます。

ChatGPTなどの生成AIにデータを入力する際に、それが故意か故意ではないかに関係なく

機密情報を含んでいればブロックすることで、情報漏洩のリスクを抑制できるでしょう。

DLP(Data Loss Prevention)の種類

- ネットワークDLP

企業のネットワークを通じて、電子メールやWebサイトのアップデートなどでデータが移動する際に、そのデータを監視・管理します。 - ストレージDLP

企業のサーバーやクラウドストレージなど、データが保存されている場所でデータを保護し、不正アクセスや不適切なデータ共有を防ぎます。 - エンドポイントDLP

PCなど個々のデバイス上でのデータの使用と転送を、監視・制御します。

生成AI利用時のネットワークDLPのイメージ

|

|

今後も、生成AIの活用が増えるにつれ、生成AIによる情報漏洩は増え続けると思います。

しかし、生成AIの利用自体を禁止することは、企業にとって大きな損失になります。

DLPで大切なデータを守ることで、安心して生成AIを活用できる環境を準備してはいかがでしょうか?

さいごに

アシストでは、DLP機能をもつ製品として

--------------------------------------------------------------------------------------------------------------

・インターネットの脅威を100%無害化する「

Ericom Shield Cloud(エリコム シールド クラウド)

」

・インターネットアクセスをワンストップで提供する「

Zscaler(ゼットスケーラー)

」

--------------------------------------------------------------------------------------------------------------

を取り扱っています。

また、アシストでChatGPTを使いたいときは、様々なセキュリティ対策を施した

--------------------------------------------------------------------------------------------------------------

・ChatGPT × 横断検索によるAIアシスタント「

Glean(グリーン)

」

--------------------------------------------------------------------------------------------------------------

を使うようにしています。

もしこれらの製品やアシストのセキュリティ対策などにご興味があれば、ぜひお気軽にお問い合わせください。

本コラムが、皆様の生成AI活用およびセキュリティ対策のお役にたてば幸いです。

参考

|

|

[ 製品ページ ] Ericom Shield Cloud

|

|

|

[ 製品ページ ] Zscaler

|

本ページの内容やアシスト西日本について何かございましたら、お気軽にお問い合わせください。

![[ 製品ページ ] Ericom Shield Cloud](/pr/west/article/__icsFiles/afieldfile/2024/07/08/202407_POP-UP_column_image2_1.png)

![[ 製品ページ ] Zscaler](/pr/west/article/__icsFiles/afieldfile/2024/07/08/202407_POP-UP_column_image3_1.png)